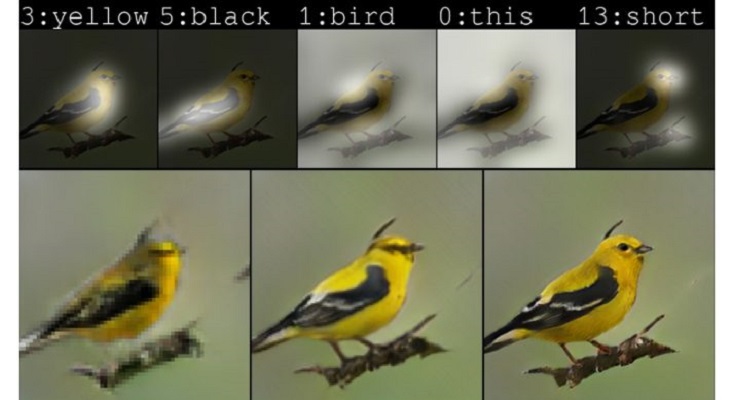

「黄色い胴体、黒い羽、短いくちばしの鳥を書いてください。」と言われた人は、まず、鳥の輪郭を下描きし、黄色のペンで胴体を塗り、黒のペンで羽を塗って、最終確認後、くちばしを短く描き、光の反射の表現を加えるという手順をとるだろう。その後、鳥の大きさをわかりやすくするため、とまっている木の枝を描くかもしれない。

とうとう、AIボットもこれと同じことができるようになった。

マイクロソフト株式会社は、Microsoft Researchで、キャプションのような文章中の単語に注目して画像を生成する、新しいAIテクノロジーを開発中であると発表した。例の注目の技術「GAN」(アテンショナル GAN)も使われている(後述)。

arXiv.orgに投稿した研究論文のテスト結果によると、従来のテキストから画像への変換手法と比較した場合、同テクノロジーでは、約3倍の画像品質の向上がみられたとのこと。

最新AIテクノロジー「ドローイングボット」とは

同テクノロジーは、「ドローイングボット」といい、家畜の群れる農村の風景などの普通の景色から、宙に浮く2階建てバスといった馬鹿げたものまで、テキストからあらゆる画像を生成。また、人工的な想像力も有しており、各画像にはテキストの説明にはない詳細な背景も含まれる。

同研究の過程

同研究には過去5年間にわたり同社の研究チームが開発してきた画像と自然言語処理という両分野が活用されていて、それに関連する研究の集大成だ、としている。

同チームは、最初に写真のキャプションを自動的に作成する「CaptionBot」を作り、次に、物体の位置や特性など画像に関する質問に回答するテクノロジーを構築。

これらの研究には物体を識別するための機械学習モデルの訓練、行動の解釈、そして、自然言語による対話が必要とされている。

CaptionBotに関する記事(英語サイト):https://blogs.microsoft.com/ai/picture-this-microsoft-research-project-can-interpret-caption-photos/

画像に関する質問に回答するテクノロジーに関する記事(英語サイト):https://blogs.microsoft.com/ai/system-trains-machines-to-look-at-images-the-way-people-do-and-answer-questions-about-them/

現在、彼らが取り組んでいる新しい技術とは、テキストを使って画像を生成するというものだ。これは、キャプションにない詳細部分の描写を、ドローイングボットが機械学習アルゴリズムにより、想像させて作り上げなければならないためキャプション付けよりも困難な作業とのこと。

Microsoft Research深層学習技術センター任研究員兼リサーチマネージャー チアドン・ホー (Xiaodong He) 氏

Bingで鳥を検索すると鳥の画像が見つかりますが、このテクノロジーを活用した場合、コンピューターによってゼロから鳥の画像が生成されます。生成された鳥は、現実には存在しないかもしれません。コンピューターが想像力によって生み出した鳥に過ぎないのです。

人間の洞察力を数学的に表現した「AttnGAN」

マイクロソフトのドローイングボットの中核にあるのは GAN (Generative Adversarial Network:敵対的生成ネットワーク)と呼ばれる技術だ。

このネットワークは 2つの機械学習モデルから構成され、生成ネットワークと呼ばれる一方のモデルが文章の記述から画像を生成し、もう一方の「ディスクリミネータ」と呼ばれるモデルが、生成された画像の正当性を文書の記述に基づいて判断する。

生成ネットワークは間違った画像で識別ネットワークを欺こうとし、識別ネットワークは欺かれないように学習する。両者が協同することで、識別ネットワークは生成ネットワークを完璧な形に近づけてく。

同社のドローイングボットは画像とキャプションのペアから成るデータセットによって訓練することにより、モデルは単語とその単語のビジュアルな表現との関係を学習することができ、たとえば、キャプションに鳥と書いてあった時には鳥を描くよう学習し、鳥の絵がどのようであるべきかを学習する。

GANは「青い鳥」や「常緑植物」といった単純な記述に基づいて画像を生成するのは得意だが、「頭が緑色で、翼が黄色で、腹が赤色の鳥」といった複雑な記述になると、文章全体が生成ネットワークに対する単一の情報として扱われ、詳細な情報が失われるため画像の品質は低下し、結果として得られるのは緑、黄色、赤が混ざったぼやけた鳥の画像であり、記述に合致するものではなくなってしまう。

人間が絵を描く時にはテキストの記述を何回も参照し、今描いている部分に関する記述に対して注意を払う。この人間の特性を獲得するために、同社の研究者たちは人間の洞察力を数学的に表現した「AttnGAN(アテンショナル GAN)」と呼ばれるネットワークを構築した。

AttnGANの特徴

このネットワークは、入力テキストを個別の単語に分解し、画像中の特定の領域と対応付けることで画像を生成する。人間的概念である「洞察力」を、数字を使ってコンピューターに身につけさせるのだ。

同モデルでは、訓練データ中の鳥の画像の多くは鳥が木の枝にとまっているため、AttnGANはテキストの記述と矛盾しない限り、鳥が木の上にとまっている画像を描ける。

これは、人間が常識と考えるものを訓練データから学び、画像中の想像に任せられた部分に学習した概念を当てはめた結果である。

今後の展開について

現時点では、まだ、同テクノロジーは完全ではなく、鳥のくちばしが黒ではなく青であったり、果物として売られているバナナが突然変異を起こしたようになっていたりなど、画像をよく見ればほとんどの場合に欠陥があると言う。

これらは、文字情報をもとに「コンピューター」が画像を作成しているためであり、このテクノロジーが与えられた文字以上の情報を加えることができる人間の能力を実現する上での重要な経過点だとのこと。

今後の活用として、画家やインテリアデザイナーのスケッチの補助や音声による写真編集ツールなどの実用的な応用が考えられ、コンピューティング能力の強化により、台本に基づいたアニメーションの自動作成などを実用化も構想中だ。

ホー氏は、AIと人間が同じ世界で共存するためには、互いにやり取りするための方法が必要であり、そのための最も重要な2つ方法が言語と画像だと述べている。

マイクロソフト ニュースセンター