NVIDIAは「GPU」(グラフィックス・プロセッシング・ユニット)の開発メーカーであるが、同時に今や自動運転の技術でもトッププレイヤーの一角を担っている。トヨタ、アウディ、メルセデス、ボルボなどの大手自動車メーカーと提携し、自社で自動運転車開発向けのAIコンピューターボード「NVIDIA DRIVE」シリーズを製品化するとともに、クラウド・プラットフォームの提供も行っている。

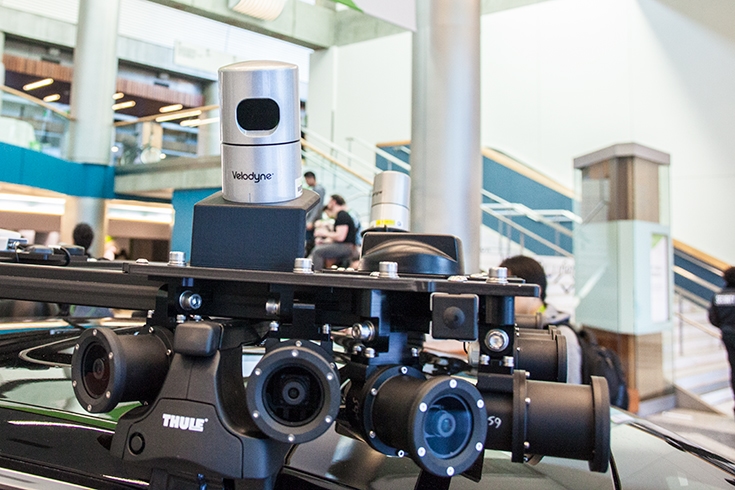

そんなNVIDIAの自動運転事業の象徴として知られているのがこの「BB8」という愛称で親しまれている車だ。米国シリコンバレーの展示会「GTC 2018」の会場ロビーにも展示されていた。これは、市販されているフォード製のハイブリッド車をベースに、NVIDIAが自動運転のためのハイテク技術を加えたモデルとなっている。

業界では、「BB8」の存在はすっかり知られているものの、一方でその詳しい仕様や機能はベールに包まれていた。今回、自動運転関連の事業を担当し、NVIDIA JapanではBB8に最も詳しいと言われている室河氏に、「GTC 2018」の会場でBB8やDRIVEシリーズについて話を聞くことができた。

BB8に搭載されているカメラやセンサー技術

編集部

「BB8」について、まずは概要から教えてください

室河(敬称略)

「BB8」は当社が開発している自動運転の試験車両の愛称です。自動運転の路上での実験に使用したり、自動運転のためにDNN(ディープ・ニューラル・ネットワーク)関連のソフトウェアやプラットフォームを開発したり、DNNのトレーニング用のデータを収集するためにも使用しています。

NVIDIAは画像処理に長けた演算装置「GPU」の開発で知られる。現在、AI技術として脚光を浴びている深層学習(ディープラーニング)の演算にGPUが効果を発揮することから、NVIDIAはAI関連企業のトップ・プレイヤーに一躍、躍り出た。同時にGPUとディープラーニングを使った自動運転関連技術の開発にも着手し、現在、同社が製品化している「DRIVE」シリーズ等を通して、トヨタ、アウディ、メルセデス、ボルボなどの大手自動車メーカーとの提携も発表している。

自動運転向けシステムの開発には、実際に走行するクルマが重要だ。このクルマでAIをトレーニングするための走行データやビジョン認識処理のための画像や動画データ、環境データなどを収集する。

編集部

この新型「BB8」はフォード製の車種がベースですね。今まではリンカーン製だったと思いますが、何か大きな違いがありますか?

室河

実は以前から、私達はフォード製とリンカーン製の両方の車種をベースにした「BB8」を使ってきました。同じグループ(ザ・リンカーン・モーター・カンパニーはフォード・モーターの一部門)なので、自動車の構成やパーツも似ていて、共通の部分が多いのです。今回のモデルでも自動車の性能に大きな違いはありません。たしかに昨年の映像等、皆さんに紹介してきたBB8はリンカーン製の車種が多かったので、このフォード製は新型モデルの印象があるのかもしれません。

編集部

このモデルにはカメラの数が大幅に増えたように感じますが

室河

この車両はカメラを12個搭載しています。カメラは主に自車両の周囲の状況を見るために使用しています。周りの自動車、バイクや自転車、歩行者、標識、信号、走行できる道路の領域などを識別するのに使用します。ただし、搭載するカメラやセンサーの数はユースケースによって変わってきます。例えば、当社が開発しているニューラルネットワークの「PilotNet」(パイロットネット)をデモする場合などはカメラは中央にひとつ搭載するだけでまかなえます。冗長性や安全性などを加味していくと、必然的にカメラの数は増えていきます。このモデルはたまたまカメラの数が多いセッティングの状態ということですね。

「システム上は、必ずしもこれらのカメラが全て必要になる」ということでもありません。この車両は実際に道路を走る際に走行データとともに「どういう道路の状況なのか」という画像情報も取得したいという理由で、周囲の状況を記録するためにこれだけ多くのカメラを搭載しています。

編集部

なるほど。カメラ以外の機器はどのようなものを搭載していますか?

室河

ルーフの上に飛び出すように設置されているのが「LiDAR」です。ベロダイン製のものを左右に2基、搭載しています。これもデータ収集のために使っています。

ほかには「GPS」と、GPSの誤差を修正して精度を向上させる「DGPS」(Differential GPS)を搭載しています。また、「IMU」(慣性計測装置)も搭載しています。

また、外観からは見えませんが、バンパーの内部に「レーダーセンサー」を搭載しています。

編集部

後方はどうでしょうか。ルーフの左右に乗っているお弁当箱のようなものは、何かのユニットですか?

室河

後方向けのカメラは1つで、その側にGPSのアンテナがあります。ルーフに乗っている箱はハイテクなものではなくて、実は単にケーブルを収納している箱なんです。この箱を開けるとケーブルが詰め込まれているだけです。トランクルームに当社の自動運転用AIコンピュータボード「DRIVE PX」シリーズが搭載されていますが、ケーブルはそれに繋がっています。

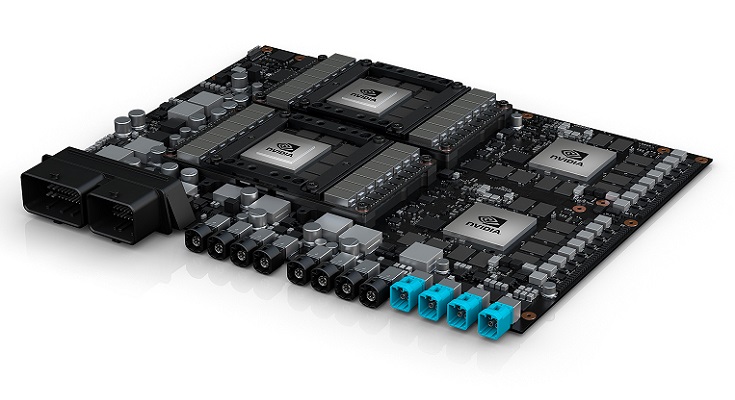

NVIDIAのシステムを活用するメーカーや研究機関の多くは、自動運転実験車のトランクルームにGPUを搭載したAIコンピュータを積んでいる。下記の写真は、会場のBB8とは別の自動運転実験車だが、トランクに積まれたDRIVEシリーズを撮った写真だ。このコンピュータが自動運転に重要な膨大な演算を処理している。

NVIDIA製の自動運転用AIコンピュータ「DRIVEシリーズ」

編集部

次に、NVIDIA製の自動運転用AIコンピュータ「DRIVEシリーズ」について聞かせてください。「DRIVEシリーズ」には現在、複数のラインアップがありますが、どのように分けられているのでしょうか。

室河

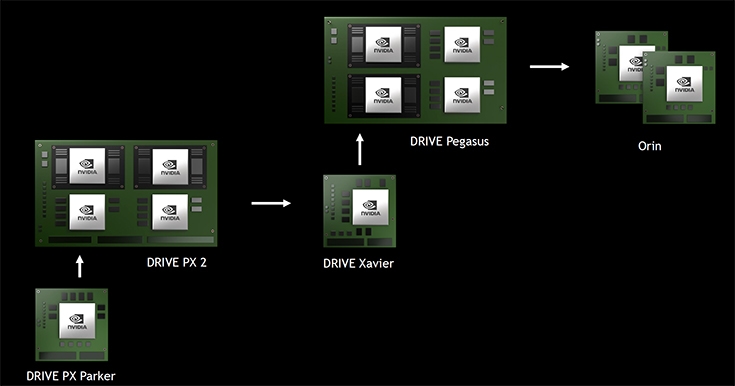

「DRIVE PX Parker」とその上位版で4チップ構成の「DRIVE PX 2」があります。ソフトウェア・アーキテクチュアとしては同じものが動作します。そのため開発者の方が「DRIVE PX Parker」用に開発したソフトウェアは、「DRIVE PX 2」にアップグレードしてもそのまま利用できるスケーラブルなものになっています。

編集部

「DRIVE PX 2」は4チップ、「DRIVE Xavier」(エグゼビア)は1チップですが、「DRIVE PX 2」の方がグレードは上なのでしょうか。

室河

「DRIVE Xavier」の方がグレードは上です。「DRIVE PX 2」は「Tegra」(テグラ:SoC)と単体のディスクリートGPUを組み合わせた4チップで構成されています。「DRIVE Xavier」に搭載されているSoCは「Tegra」ではなく、「Xavier」と呼ぶ新しいSoCですが、これは「DRIVE PX 2」の4チップとほぼ同等の性能を1チップで実現したものになります。更にSoCの「Xavier」を2つと次世代のGPUを搭載した4チップ構成のものが最上位の「Pegasus」になります。「Pegasus」は「DRIVE PX 2」と比較すると約16倍の高速処理性能があります。

編集部

自動運転には「レベル2」や「レベル5」など、要求される技術や機能に違いがあると思いますが、どのDRIVEシリーズを使っても実現できるものなのでしょうか?

室河

ロボットタクシーのように「レベル5」になると、おっしゃる通り、要求される技術レベルも高度になるので、より高い処理能力を持つ「DRIVE Pegasus」をご利用頂くのが現時点では最良の選択になると思います。「DRIVE PX 2」ではレベル2やレベル3が最適で、レベル5は難しいかもしれません。ただし、「DRIVE PX Parker」から「DRIVE Pegasus」まで、ソフトウェア・アーキテクチャとしてはすべて共通でスケーラブルになっています。

例えば、「DRIVE PX 2」で自動運転のレベル2やレベル3の技術開発をしていて、「レベル5」が必要になったときには「DRIVE Pegasus」を採用し、今までのソフトウェアやシステムをそのまま使用したり、それを土台に拡張していくことができます。これは開発現場にとっては大きなメリットだと思っています。

編集部

なるほど、メーカーが実現したい自動運転のレベルによって、「DRIVEシリーズ」の最適なモデルを選択すれば良いわけですね。

ところで、日本でもBB8の目撃情報がSNS上では上がっていますが・・

室河

はい。日本でも既に走行データなどの情報収集と蓄積のために「BB8」は走っています。ただ、もちろん日本の公道ではトレーニングを受けたドライバーが運転して、その情報を収集しています。朝から夜までさまざまな時間帯で、更には雨や風、雪道などの天候による道路状況の変化などのデータも蓄積しています。特に悪天候の際の視界や道路状況の変化等は自動運転に向けたデータとしてはとても重要です。

編集部

カメラの話に戻って恐縮ですが、この車の前方に設置されたカメラが複数なのは、広い角度を見るためですか?

室河

角度というより距離の違いです。この3つのカメラは同じ方向を向いていますが、それぞれ近くを見るカメラ、遠くを見るカメラ、その中間、という具合です。もちろん画角も異なっていて、近くを見るカメラがより広い領域を見ることができます。また、横を見るカメラがあれば、交差点などで横から来る車や自転車、歩行者などを確認できます。斜め後方のカメラは、走行レーンをチェンジするときに隣の車線を走っている車両を確認するのにも有効ですね。安全性を考えれば、カメラの数は多い方が良いので、複数のカメラを搭載することが主流になっていくと思います。

また、悪天候や夜の走行などカメラが見づらい環境でも、レーダーやセンサーが周囲の状況を捕捉します。レーダーとカメラの両方の情報をフュージョンして運転に活用することが重要ですね。今はまだ車載用の屋外カメラとして利用できるカメラの機種は豊富に選べるというほどの種類は発売されていません。一方で、高解像度のカメラがリリースされはじめて、少しずつ増えそうな気配なので、当社のシステムも様々なカメラ機種に順次対応するように開発しています。

編集部

カメラが高解像度になるとデータも大きくなって、演算の負荷も大きくなるかと思います。自動車側(エッジ側)とクラウド側のどちらに負荷が大きくなるのでしょうか?

室河

そうですね。カメラの解像度が向上すると画像の容量も大きくなり、処理をするのにより高速なGPUやAIシステムが要求されるようになります。しかし、解像度が高くなればそれだけ、システムが鮮明な映像を見ることができ、得られる情報が多くなるなど、とても大きなメリットがあるため、今後も高解像度化の方向に向かっていくと予想しています。

その際、走行に関しては自動車(エッジ側)に搭載したAIコンピュータの負荷が大きくなるでしょう。一方、機械学習などのトレーニングではクラウド側に負荷がかかるので、より高速なGPU演算のシステムが必要になっていくと考えています。

編集部

ソフトウェアも進化していますか

室河

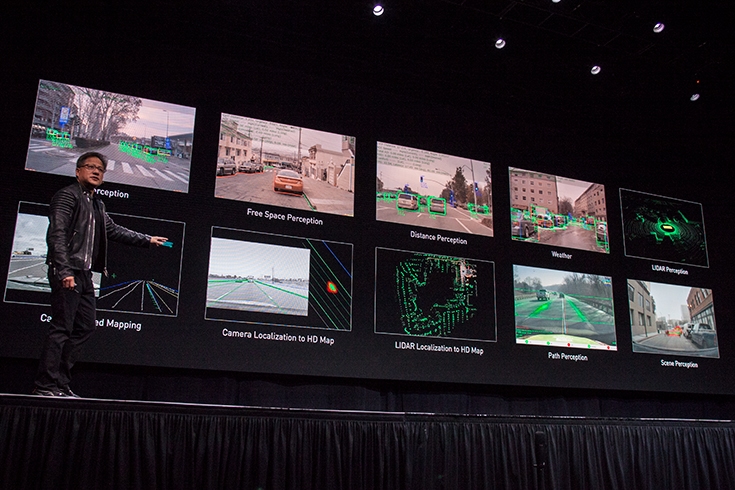

はい。基調講演でも新しいニューラルネットワーク関連のものが初披露されました。例えば、交差点があることをニューラルネットワーク自身が判断している映像などがあったと思いますが、それです。

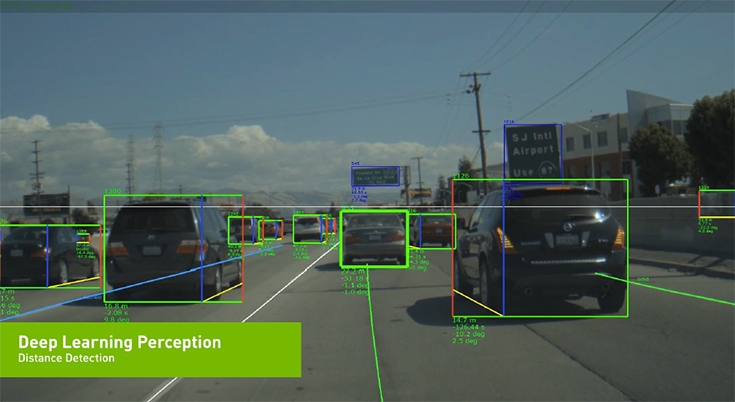

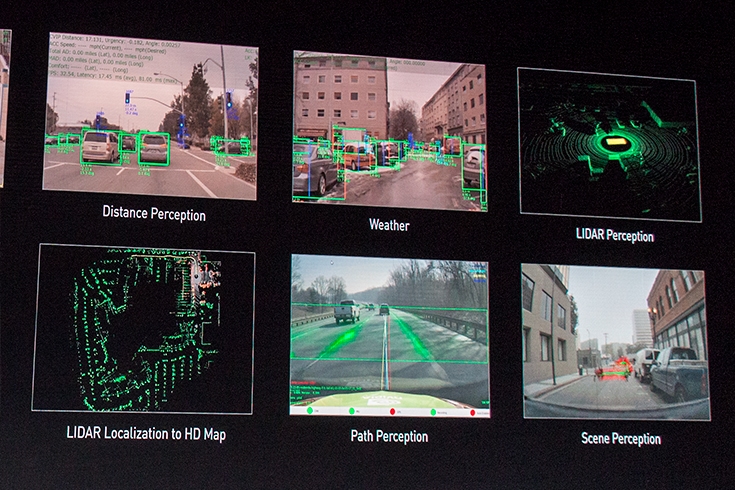

次の映像は「GTC 2018」で公開されたもので、自動運転中のビジョンやセンサー、LiDARが稼働している様子がわかる。また、居眠り運転を検知して警告するなど、安全運転支援の機能も紹介されている。

編集部

今後の進化がますます楽しみです。今日はお話を聞かせて頂き、ありがとうございました。

最後にBB8関連の動画を 2つ紹介しよう。ひとつは急な坂が多いサンフランシスコの名所、ヘアピンカーブが連続して続くロンバード・ストリートを自動運転で下る映像。もうひとつは、ランボルギーニ、アウディ、BMW、MINI、テスラなど、大手自動車メーカーと連携したコンセプトムービーとなっている。

【動画あり】GPU搭載の自動運転デリバリーロボット「Robby」をシリコンバレーで見た!(第1回) 動くクーラーボックスみたいで可愛い

GPU搭載の自動運転デリバリーロボット「Robby」をシリコンバレーで見た!(第2回) NVIDIAにスマートマシン事業戦略を聞く

【GTC 2018】NVIDIAのロボット開発環境「ISAAC」(アイザック)とは? ロボット活用と開発の未来をAIが変える 〜SDKも発表〜

【GTC2018】基調講演で「Holodeck」を使って無人の車を遠隔操縦!観客騒然!自動運転には遠隔操作も必要か

【GTC 2018】NVIDIAのCEOが基調講演でAIとディープラーニングの未来を語る!自動運転、ロボット開発環境、リアルタイムレイトレーシング、世界最大のGPU「DGX-2」等を発表

【GTC 2018現地レポート】トヨタAI研究所「Toyota Research Institute」が開発する2モードの自動運転ソフトウェア!AWSや開発環境も公開

GTC 2018特集 (ロボスタ)

NVIDIA特集 (ロボスタ)

ABOUT THE AUTHOR /

神崎 洋治神崎洋治(こうざきようじ) TRISEC International,Inc.代表 「Pepperの衝撃! パーソナルロボットが変える社会とビジネス」(日経BP社)や「人工知能がよ~くわかる本」(秀和システム)の著者。 デジタルカメラ、ロボット、AI、インターネット、セキュリティなどに詳しいテクニカルライター兼コンサルタント。教員免許所有。PC周辺機器メーカーで商品企画、広告、販促、イベント等の責任者を担当。インターネット黎明期に独立してシリコンバレーに渡米。アスキー特派員として海外のベンチャー企業や新製品、各種イベントを取材。日経パソコンや日経ベストPC、月刊アスキー等で連載を執筆したほか、新聞等にも数多く寄稿。IT関連の著書多数(アマゾンの著者ページ)。