2015/07/01 アンジェリカさんを囲む会に行ってきました。

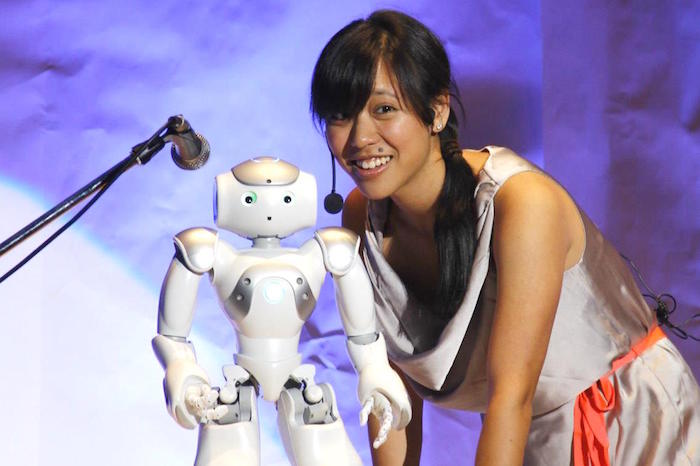

アルデバラン本国のエンジニアのアンジェリカさんが来日されましたので、囲む会が開催されました。

場所はおなじみ秋葉原のアルデバランアトリエ。

アンジェリカさんはロボットの目の前にいる人間の感情を推測する部分を作っているソフトウェアを担当したそうです。

今回、開発者自らからその機能を説明いただけるという貴重な機会です。

[Preload Mood]ボックスと、[PersonState]ボックス。

[Get Mood]というボックスはPepperが目の前の人を3秒見て、そこから人間が positive・nagative・newtral・unknown のどの状態かを認識、判断してくれるというものです。そのあと[Switch Case]ボックスで分岐させます。

その状態は、Pepperのタブレットにリアルタイムのグラフでポジティブ・ネガテイブが表示されます。

みんなで、Pepperにいろいろな表情を試してみてグラフがどう変わっていくか試してみました。これは面白いです。

この仕組みは、目の前の人を7つの項目(Facial expressions,Speech semantics,Touch,Head angles,Vocal emotion,Laughter,Distance)からからポジティブかネガティブかを判断しているそうです。

この7つの項目で一番優先されるのは、表情だそうです。

この後、アルデバランのKawataさんから、Pepperデベロッパープログラムのアップデートについてお話がありました。近日中にデベロッパー向けにいろいろとあるそうなので、要チェックですよ。

ABOUT THE AUTHOR /

北構 武憲本業はコミュニケーションロボットやVUI(Voice User Interface)デバイスに関するコンサルティング。主にハッカソン・アイデアソンやロボットが導入された現場への取材を行います。コミュニケーションロボットやVUIデバイスなどがどのように社会に浸透していくかに注目しています。