Softbank World 2016 二日目の16:40から行われた「Pepperと拓くクラウドを利用したデジタル改革」のレポートです。

プログラム概要は以下のとおり。

マイクロソフトの画像認識技術は、ImageNet によって世界トップクラスと認定されました。この技術はすでに皆様のビジネスで活用できるサービスとして提供が始まっています。本セッションでは、Pepperとマイクロソフトの画像認識技術が連携して実現する未来をデモと開発事例を交えてご紹介します。

登壇されるのは、日本マイクロソフト 執行役 最高技術責任者 榊原彰氏です。

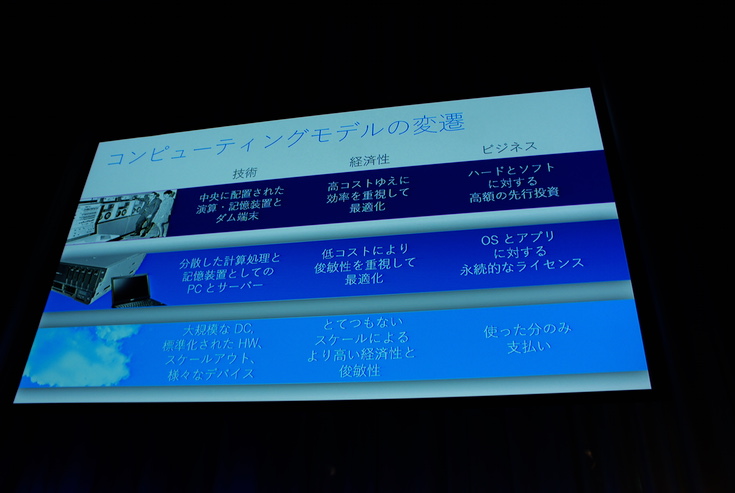

コンピューティングモデルの変遷

昔は高価なハードをみんな大切に使っていました。その後、分散技術が高まってハードの価格が下がり、ソフトの価格が上がりました。現在ではクラウドの時代になり、従量課金の時代になりました。ガスや電気と同じ感覚でITが利用できるようになりました。

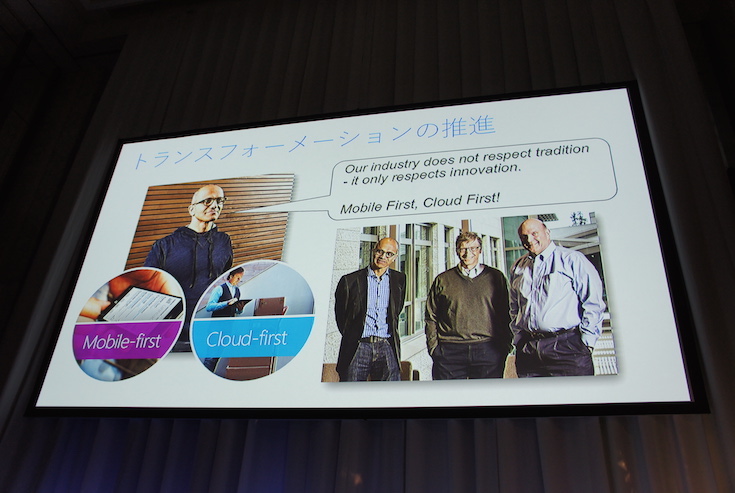

マイクロソフトの変遷

未だWindowsとOfficeの会社と言われることの多いマイクロソフトですが、今はがらりと変わり、クラウドを主軸に置いています。いかにクラウド上で安いコンピューティングパワーを使っていただくかを主眼に置いています。

マイクロソフト3代目CEOがサティア・ナデラとなり、彼のフォーカスエリアは「Mobile-first」「Cloud-first」です。常にモバイルのことを考え、常にクラウドのことを考え、そこが出発点として色々なソリューションを作っていくという会社に大きく変わっています。

マイクロソフトが取り組んでいる開発研究

世界地図の赤が開発拠点、緑が研究所です。研究開発は、ソフトやハード、クラウド、botをやっていたりします。中には量子コンピュータをやっている研究所もあります。

現在取り組んでいる面白い研究開発を2つ紹介します。

左側の「Pre-Touch Sensing」は、触る前からどこを触るかをデバイス側で予測をするというものです。これにより、狭い画面で適切なメニューを表示させることが可能になります。

右側の「Handpose」は、手の動きを非常な高精細にハンドトラッキングするというものです。バーチャルリアリティの世界でつまみを掴んだり、スライダーをスライドさせたりできます。

微妙なオペレーションが必要な動きを遠隔地からできるようになります。例えば、外科手術などは非常に微妙な動きが必要となります。このようなことができる可能性も秘めています。

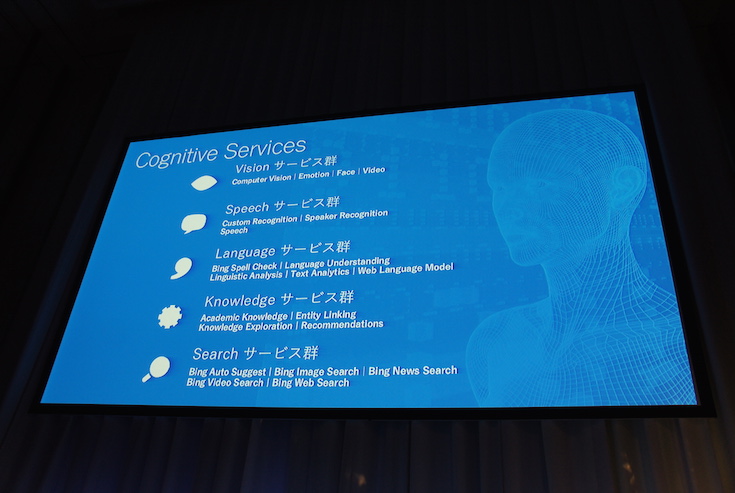

マイクロソフトのコグニティブサービス

AI、ロボティクス、Iotで使われることが多いであろう、マイクロソフトのコグニティブサービスの紹介です。

視覚系、認識系のサービス、スピーチ(会話)、言語系サービス、知識系サービス、検索といった、人間の目と耳と口にあたる部分をサービスのAPIをして提供しています。

人工知能をやっている会社はたくさんありますが、マイクロソフトでは非常に安価にこれらのAPIを使うことができます。

会話認識や画像認識に強いディープラーニングという考え方があります。ニューラルネットワークというテクノロジーを使うのですが、これが非常に多くのコンピューティングパワーを使います。

コンピューターをいっぱい使って、計算をいっぱいやって、どれぐらいの正確性を保てるかというのが、各社が争っている争点になっています。

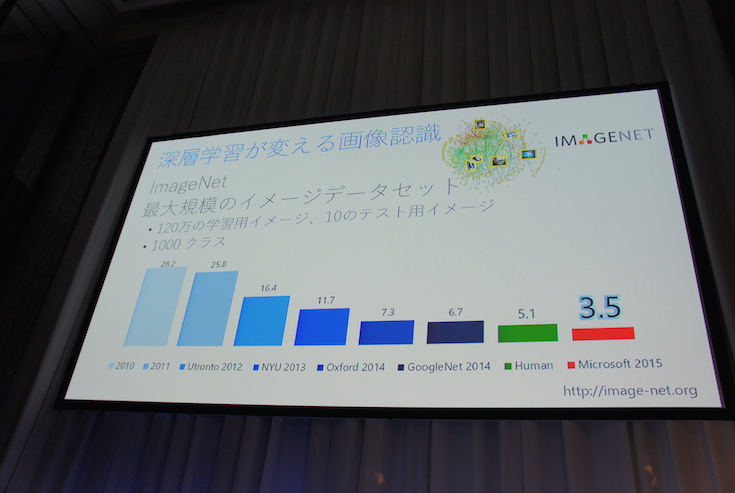

人間よりも誤認識率の低い、マイクロソフトの画像認識

マイクロソフトではImageNetという巨大な画像データベースのサイトで毎年繰り広げられるコンテストで、2015年にNo.1になりました。スライドには歴代のNo.1が書かれています。数字は、画像認識をした時の誤認識率です。

過去は大学がNo.1になることが多かったのですが、2014年にはグーグルがNo.1になりました。人間の画像誤認識率は5.1%で、マイクロソフトは去年人間の誤認識率を上回り、人間の限界を超えました。誤認識率3.5%でNo.1となり、世界のトップを走っていると自負しております。

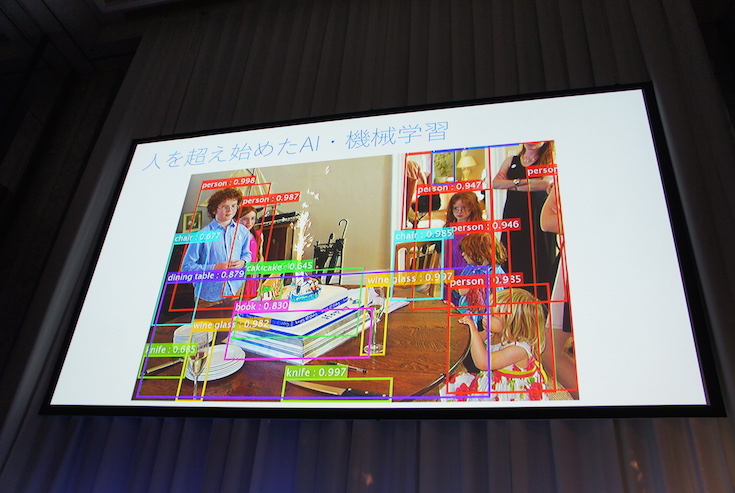

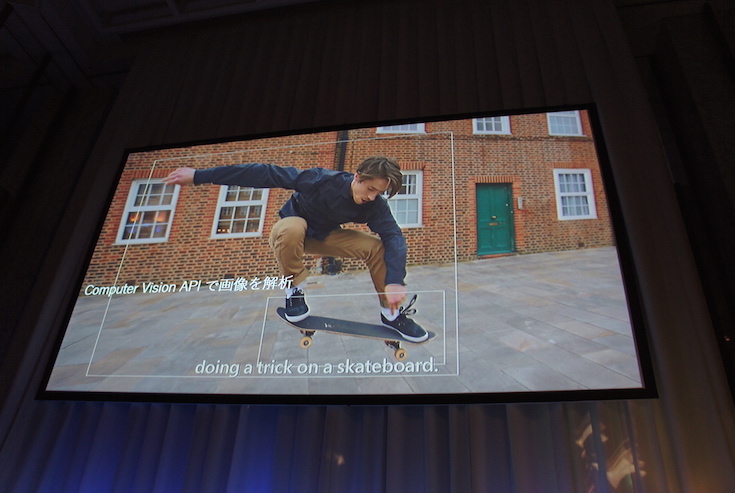

実際の画像認識の様子です。

画像認識で重要なのは、写っているものが何なのかを理解するという点です。人間の写っている写真を見て「これは人間だ」とコンピューターが認識するのは非常に難しいことです。これを深層学習の色々な解き方で数値を上げていっています。

CPUからGPU、GPUからFPGAへ

マイクロソフトの認識技術は、画像認識・動画認識・機械翻訳・音声通訳・検索を使ってやっています。

認識技術ではGPU(Graphics Processing Unit)を使い、より早い処理を行うことが主流になってきています。ただし、GPUは消費電力が多いので、最近ではFPGA(Field-Programmable Gate Array)を使ってはどうだという話になってきています。

マイクロソフトではマシーンラーニングをFPGAの上で動かすということにもチャレンジしており、研究領域としてかなり進んできています。

画像認識のデモ

ここで、マイクロソフトの鈴木氏によるデモを行います。

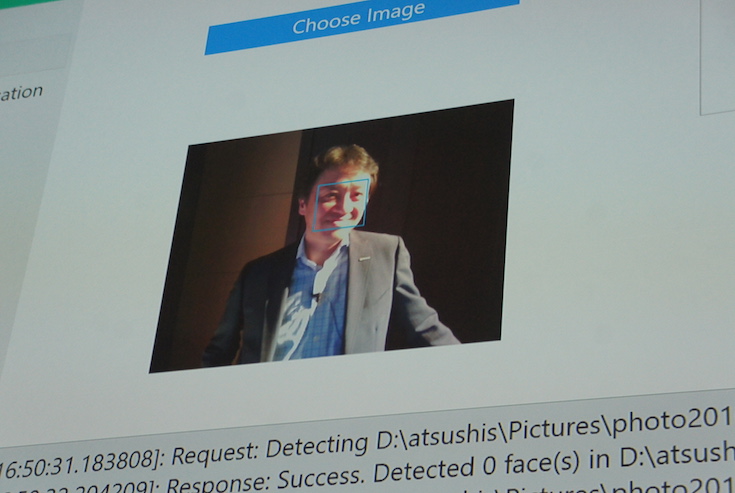

榊原さんの顔写真を撮らせてください。

今撮影した写真をFaceIDとして読み取ってみます。顔の部分に青い四角が付いているのに注目してください。

画像というのはコンピュータにとってはデータで、そのデータから顔をいう部分を抽出しています。データから抽出することができれば、比較をすることもできます。

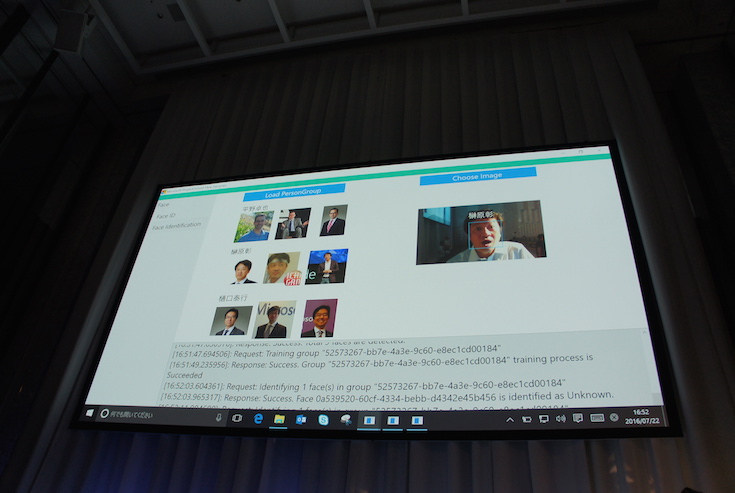

事前に用意した3名(平野氏、榊原氏、樋口氏)の写真があります。先程撮影した写真を選んでみると、榊原と認識ができました。

事前に用意した写真と同じものがないのに、榊原と認識することができるのです。

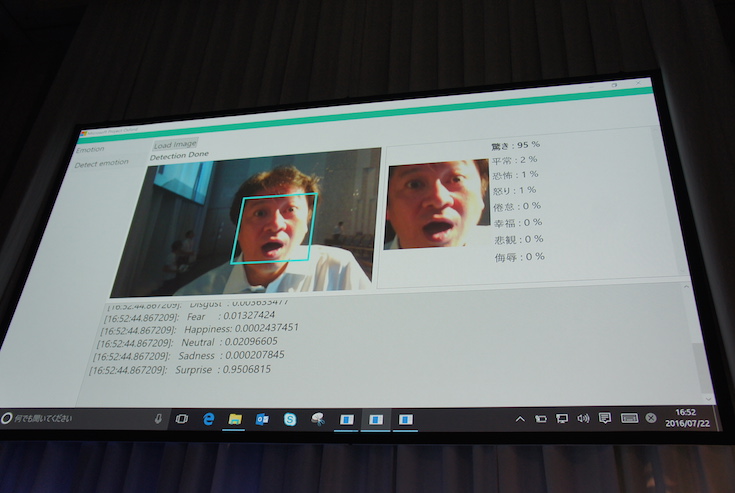

同じように、もう1つ顔を認識します。写真から表情を読み取ってみます。右側を見てみると、感情が数値化されています。驚き95%と出ており、確かに驚いている表情です。感情を読み取るということで、非常に有益な情報を得ることができます。

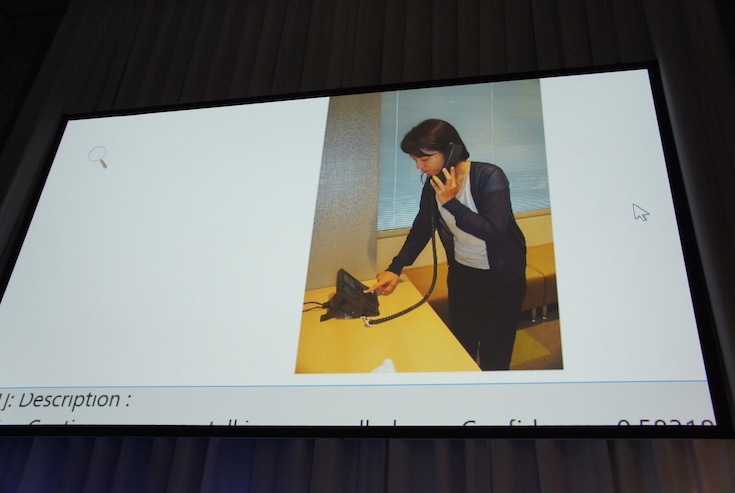

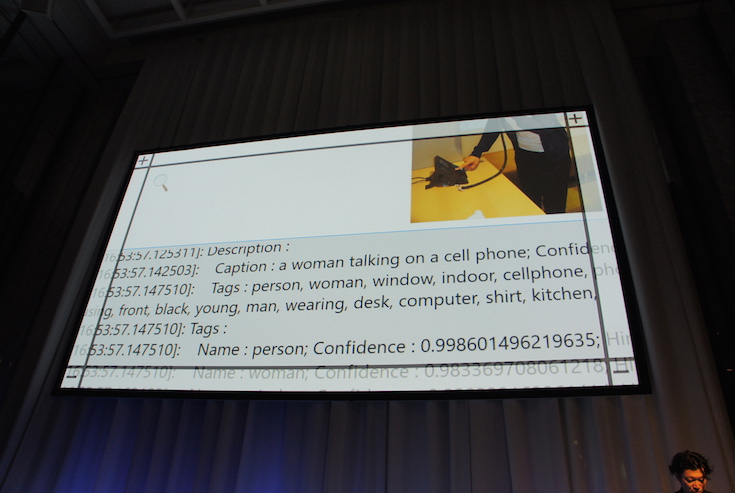

次に、写真からどういう景色なのかを読み取ってみます。事前に用意したこの写真を解析してみます。女性が電話をしている写真です。

解析後のCaptionの部分を見てみると「a woman talking on a cell phone」と認識しており、状況をほぼ把握していると言えます。現状、これくらいの精度を出すことができます。

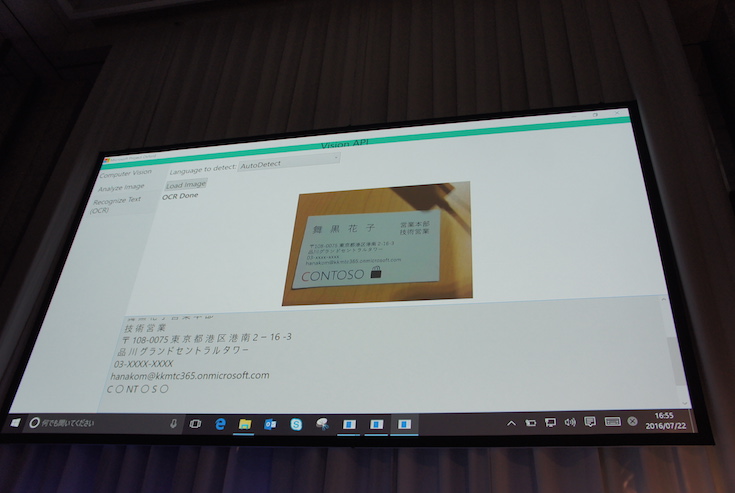

名刺を写真で撮って画像からテキストを認識させることもできます。漢字、数字、アルファベットの全てが認識できています。

アクセシビリティについて

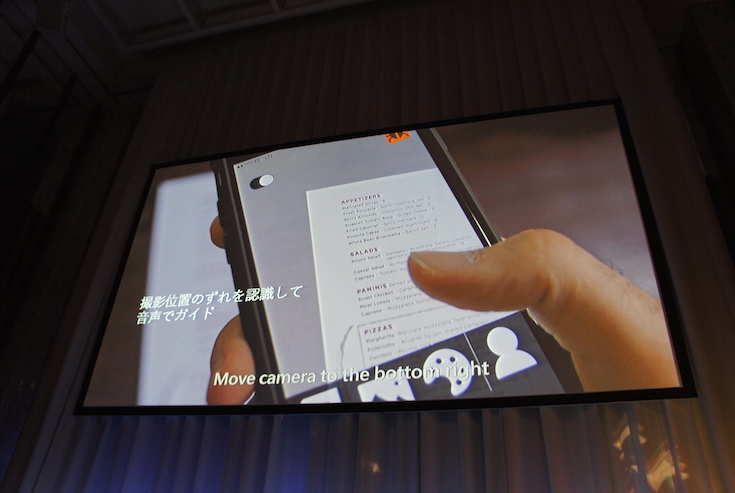

次のこちらの動画をご覧ください。マイクロソフトのソフトウェア開発者です。彼は7歳の時に視力を失って、全盲です。

歩いている途中に前からすごい音を上げてくるものが来ました。

その時、彼はメガネの横の部分をスワイプします。

すると写真を撮影されて、コグニティブサービスに送信します。これを画像解析をして、今どういうことが起こったかということを声で教えてくれます。

次は会議の最中です。出席者の感情を知りたくなった時に撮影して画像解析をすると、参加者の感情を知ることができます。

レストランに行った時は、メニューを写真で撮影して認識し、どういうメニューがあるかを声で知らせてくれることもできます。

これらは、アクセシビリティの観点として非常に重要なことです。

Pepperとコグニティブサービスを連携させた事例の紹介

Pepperとコグニティブサービスを連携させて、Pepperに仕事をさせるシステムを構築した、株式会社ヘッドウォータース 代表取締役 篠田庸介氏に登壇いただきます。

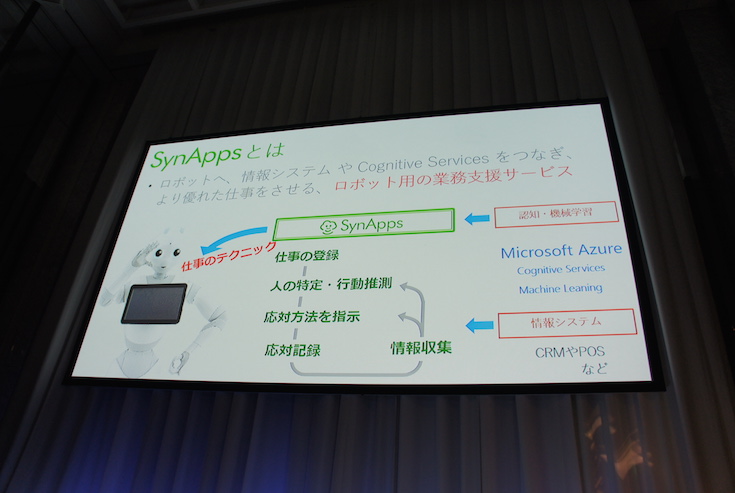

同社では「SynApps(シナプス)」をいうサービスを開発しました。

こちらはロボットがお仕事をする時に業務支援をするためのサービスです。人間も会社で業務支援システムを使っていますが、ロボットにも業務支援サービスを使ってもらうことで、より高度な作業ができるだろうという考えです。

基本は、いろんなロボット1台1台に仕事をお願いします。ロボットが複数台いても、1台1台に対して仕事の指示をすることができます。これをAzure上のコグニティブエンジンや推測エンジンを使って、さらに高度な業務内容をロボットに指示することができるというものです。

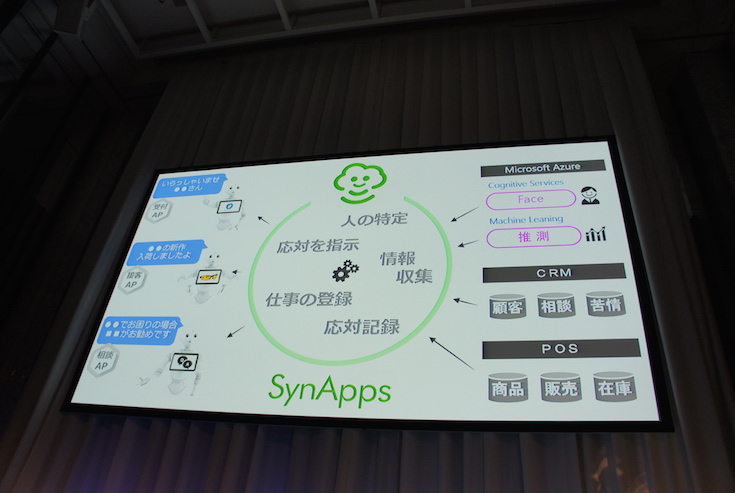

店舗等で行われる業務に「受付・接客・相談」があります。

お客様が来ると、Pepperはカメラで人間の画像認識をします。この画像をコグニティブサービスに送ると、その人が誰かを特定します。これはCRMシステムと連携して、顧客情報を取得して特定を行っています。

店舗に入った後はCRMから過去の購買履歴や相談履歴を取得して、推測エンジンを使い、お客様が何を購入したいのかを推測し、オススメすることもできます。

接客履歴がたまればビッグデータになるので、クレームや相談事が発生した時には、柔軟に対応することが可能になります。

実際のデモの様子は以下の記事をご覧ください。

【SoftBank World 2016 徹底レポート(10)】 Pepperが顔を覚えて、次回の訪問時に名前を呼んでくれる「顔認識会社受付」 | ロボスタ

ロボットは最初から頭がいいわけではないので、学習をさせないといけません。学習させるためには接客効果を数値的に測らないとなりません。マシーンラーニング上で学習させるという事も出来ますが、人間がいい接客/悪い接客の効果を測定して、学習させられる事もできます。

こちらのログレポートを見て、見た人が好みの学習をPepperにさせられる事ができます。

Pepper meets Microsoft Azureの取り組みについて

ここからは、ソフトバンクロボティクス株式会社 事業推進本部 本部長 吉田健一氏による、Pepper meets Microsoft Azureの取り組みについてお話いただきます。

PepperとMicrosoft Azureとの取り組みは、2016年3月に提携の発表をしました。その際、冬までには連携する商品を出したいとも発表しました。

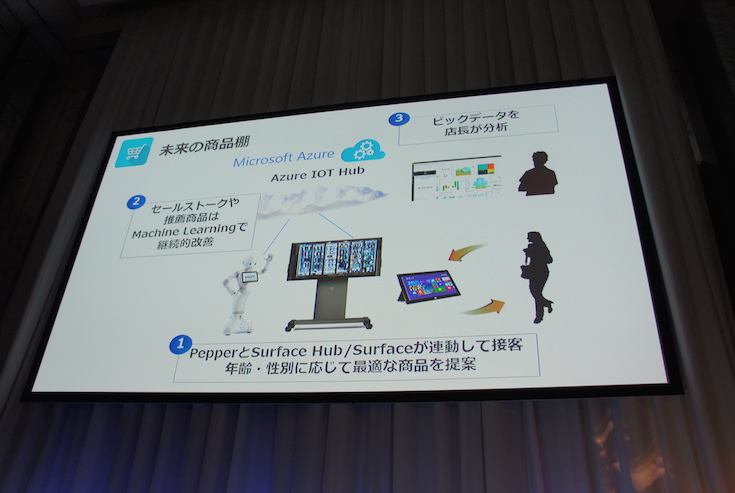

連携して生まれた商品の1つが「未来の商品棚」です。

PepperとSurface Hub/Surfaceが連動して接客し、年齢・性別に応じた最適な商品を提案します。セールストークや推薦商品はマシーンラーニングで継続的に改善し、そのビッグデータを分析するというものです。

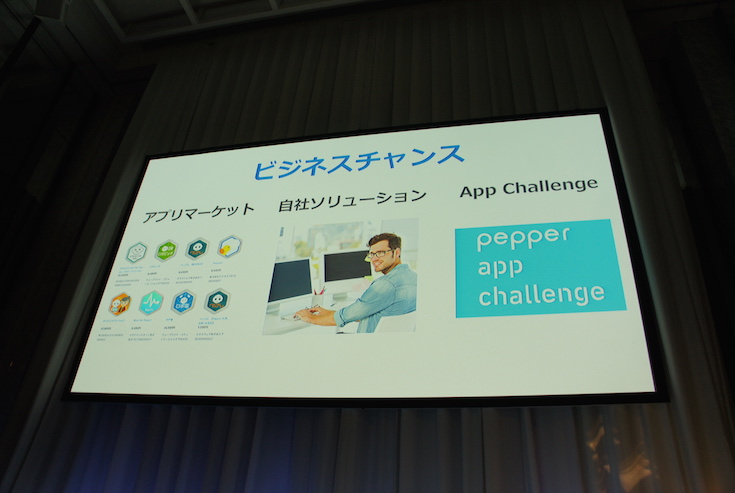

ロボアプリパートナーとの取り組みと、次回Pepper App Challenge

現在、デバイスはだいぶ整ってきました。クラウドも充実してきた。現在アプリが業務でどのように使うかが重要になってきています。ロボアプリパートナーさん一緒にキラーアプリを作っていただく事が必要と考えます。

ロボアプリパートナーとの取り組みです。Pepperのビジネス用アプリのマーケットでロボアプリを販売したり、自社ソリューションと連携させたり、Pepper App Challengeというロボアプリコンテストを開催したりしています。

次回のPepper App Challengeは今年の冬開催予定で、今回はAzureとの連携が一つのテーマになると考えています。

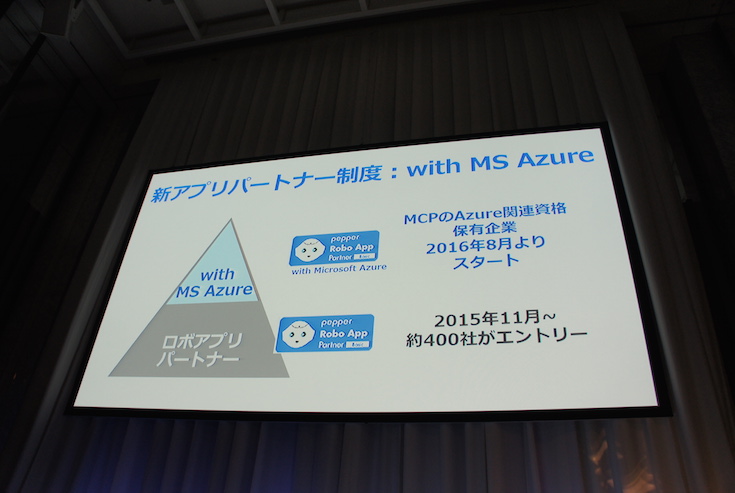

ロボアプリパートナー with Microsoft Azureがスタート

今日発表したいのは、2つ。1つ目は、新しいアプリパートナー制度です。

今までPepperロボアプリパートナー制度がありましたが、2016年8月からPepperにもAzureにも詳しいロボアプリパートナー with Microsoft Azureというのをスタートします。

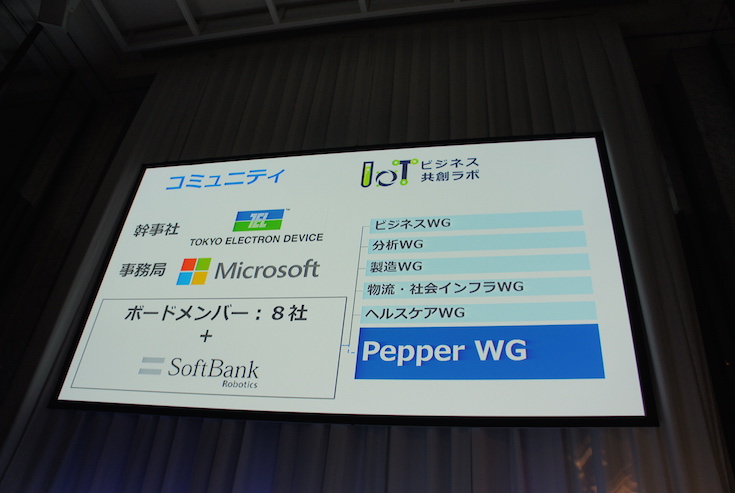

Iotビジネス共創ラボにPepper WGが新設

2つ目は、Microsoftが事務局を行っている「Iotビジネス共創ラボ」にPepper WGを新設します。

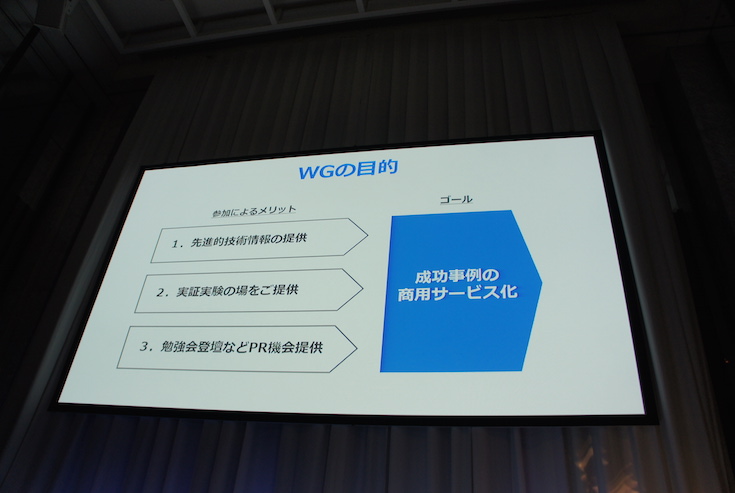

最終的な目的はこのワーキンググループで事例を作ることです。それを商品化をしたいと考えます。

8月24日に第一回のワークショップを開催しますので、興味ある方は是非ご参加下さい。

まとめ

最後に。ロボットやAIが出てくると、人間の仕事が奪われれしまうのではないかと懸念される方もいるかもしれません。

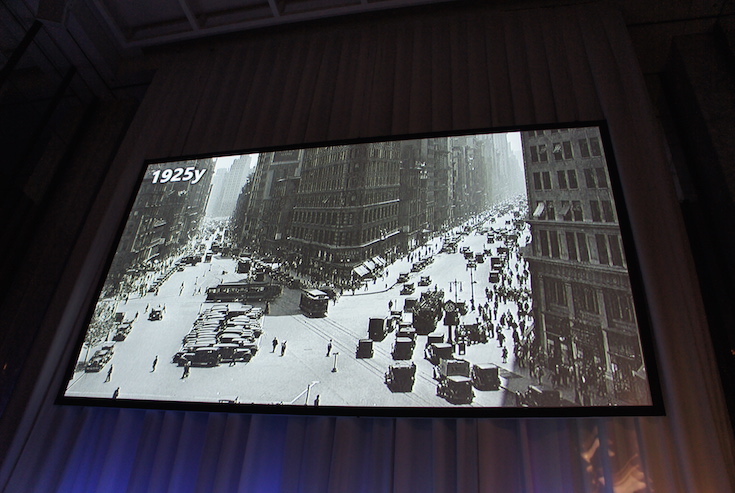

以下の写真をご覧ください。

1枚目は1905年のニューヨークの写真です。見てみると、馬車がいます。この頃、アメリカの農産物の25%が馬のための飼料でした。

2枚目の写真は20年後です。馬車は一台もなく、全て自動車になっています。これにより多くの新しい雇用を生み出しました。新しい時代は新しい雇用を生み出します。

私たちは、新しい未来を創っていきたいと思います。

今日はありがとうございました。

ABOUT THE AUTHOR /

北構 武憲本業はコミュニケーションロボットやVUI(Voice User Interface)デバイスに関するコンサルティング。主にハッカソン・アイデアソンやロボットが導入された現場への取材を行います。コミュニケーションロボットやVUIデバイスなどがどのように社会に浸透していくかに注目しています。